注目集めるディープシーク 次世代モデルに期待

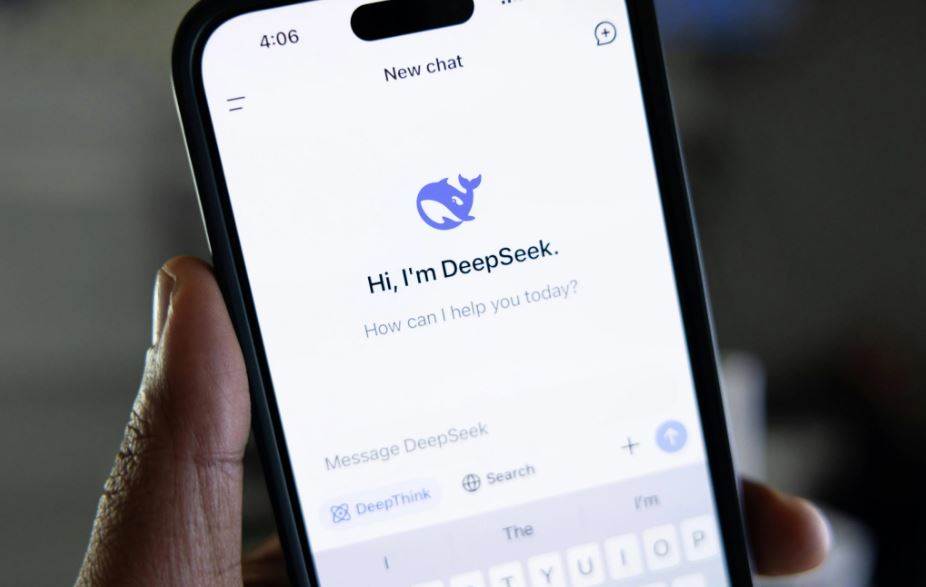

中国の人工知能(AI)スタートアップ企業であるディープシーク(DeepSeek)の次世代モデル発表が期待される中、同社は大規模言語モデル(LLM)の推論能力を向上させる新たな手法を発表しました。

最近公開された論文によると、ディープシークは清華大学の研究者と協力し、「生成的報酬モデリング(GRM)」と「自己原則評価調整」という技術を組み合わせた手法を開発しました。このアプローチにより、LLMが一般的な質問に対して、より正確かつ迅速に回答できるようになることを目指しています。

研究者らは、この手法を採用したディープシーク-GRMモデルが既存の手法を上回り、強力な公開報酬モデルを活用することで「競争力のあるパフォーマンスを発揮した」と報告しています。報酬モデリングは、LLMを人間の好みに適合させるためのプロセスです。

ディープシークはGRMモデルをオープンソース化する意向を示していますが、具体的な公開時期については明らかにしていません。

一方で、ディープシークの基盤モデル「V3」および推論モデル「R1」が世界的に注目を集める中、同社の次の展開に関する臆測が飛び交っています。海外メディアは、ディープシーク-R2が間もなく公開される見込みと報じました。ディープシーク-R1は、コストパフォーマンスに優れた性能を持ち、既存のトップモデルと肩を並べる実力を示したことで、世界のテクノロジー業界に衝撃を与えました。

しかし、ディープシークはR2の発表については沈黙を守っています。

浙江省杭州市に本社を置く同社は先月、V3モデルを「ディープシーク-V3-0324」にアップグレードし、推論能力の強化、フロントエンドウェブ開発の最適化、そして中国語の文章生成能力の向上を実現したと発表しました。その次なる一手に、世界中の関心が集まっています。

4月25日ニュース

00:00 /